Technologie-Überblick zur Tiefenerfassung

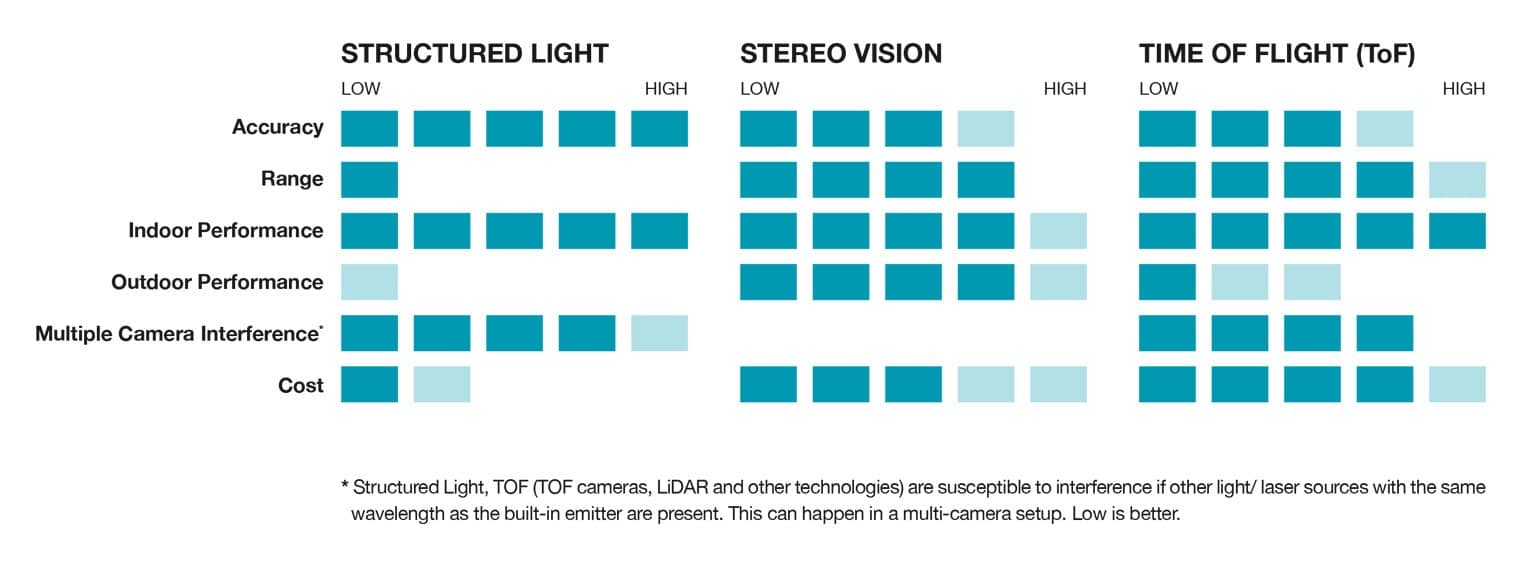

Mit Technologien zur 3D-Tiefenerfassung können Geräte und Maschinen ihre Umgebung wahrnehmen. In letzter Zeit haben die Tiefenmessung und die dreidimensionale Wahrnehmung in vielen Branchen und Anwendungen an Bedeutung gewonnen. Zu den Anwendungen in industriellen Umgebungen zählen die Prozessoptimierung und Automatisierung, die Robotik sowie autonome Fahrzeuge. Es gibt viele verschiedene physikalische bzw. technische Ansätze, um Tiefeninformationen zu generieren. Nachfolgend finden Sie einen Überblick über die wichtigsten Verfahren im Vergleich, damit Sie besser beurteilen können, welches Verfahren für Ihre Anwendung am besten ist.

3D Depth Sensing

WHITEPAPER "3D Vision in der Industrie"

Die richtige 3D-Vision-Lösung finden: Ob Automatisierung, Mensch-Maschine-Kollaboration in der Robotik oder selbstfahrende Autos – die Auswahl des richtigen Sensors hängt stark von der Applikation und dem gewünschten Output ab.

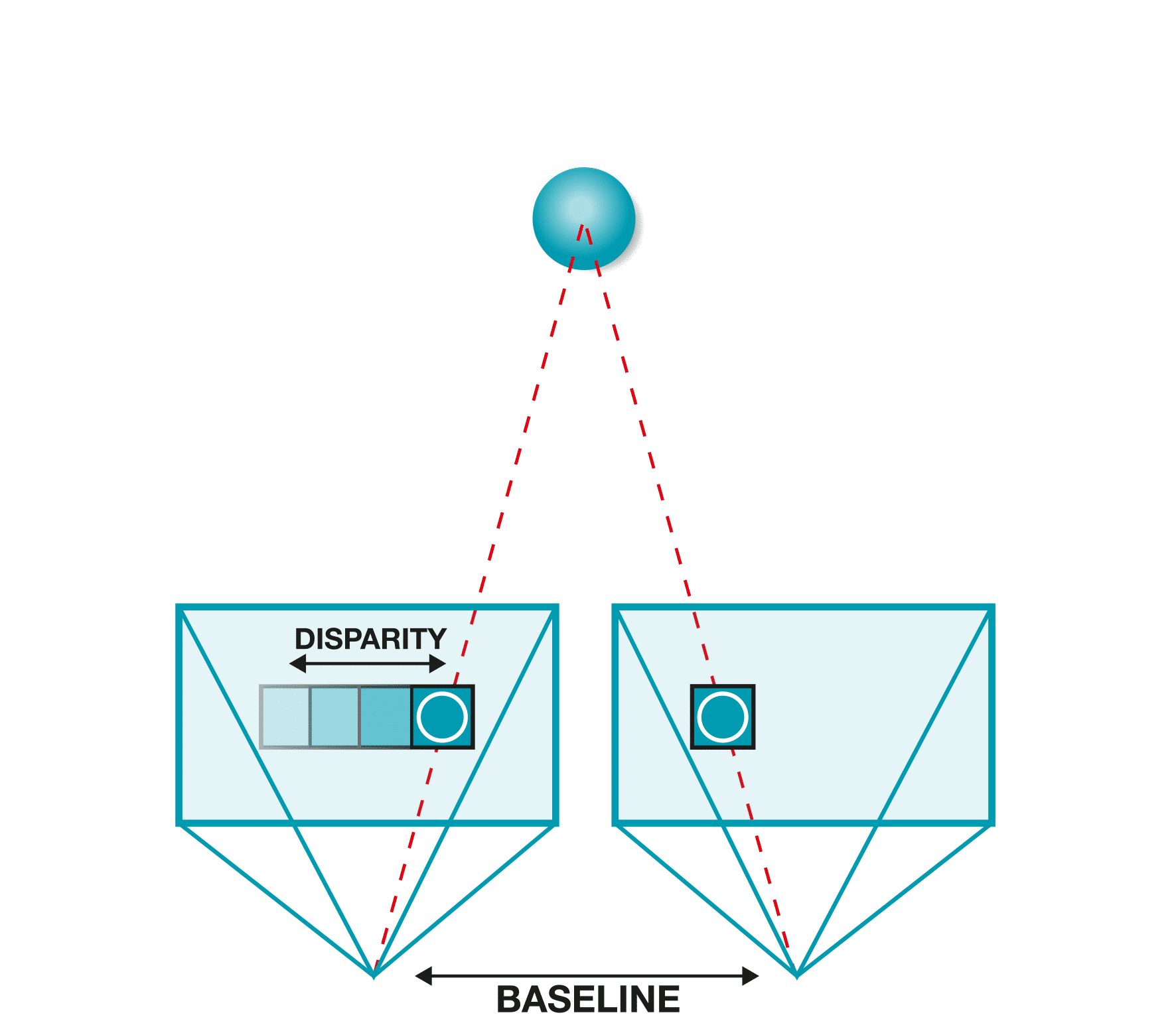

Funktionsprinzip Stereo-Vision

Stereo-Vision entspricht im Prinzip dem menschlichen Sehen. Die Technologie ermittelt eine quantifizierbare Tiefenwahrnehmung, indem Objekte mit zwei Kameras aufgenommen werden. Die Kameras befinden sich dabei auf einer gemeinsamen Grundlinie (Baseline) und haben einen festen Abstand zwischen den beiden Linsenmittelpunkten. Somit erfasst jede der beiden Kameras die Szene in einem leicht anderen Winkel. Je näher ein Objekt ist, desto mehr sind dessen Merkmale in beiden Bildern verschoben. Diese Verschiebung wird als Disparität bezeichnet. Mit dem Disparitätswert, der sich aus den beiden Bildern ergibt, lässt sich eine Tiefenkarte (Depth Map) berechnen. Passive Systeme nutzen das vorhandene Umgebungslicht oder eine künstliche Beleuchtung, um das Objekt anzustrahlen. Aktive Systeme verwenden eine Lichtquelle, um einer Szene durch Projektion zufällige Merkmale hinzuzufügen, die die Erkennung des Objekts in den beiden aufgenommenen Bildern verbessern. Meistens werden Infrarot-Laserprojektoren mit Pseudo-Zufallsmustern verwendet, aber auch strukturiertes Licht ist möglich. Die Vorteile der (aktiven) Stereo-Vision-Technologie sind die Robustheit bei wechselnden Lichtverhältnissen und die einfache Einrichtung mehrerer Kameras, da sich diese nicht gegenseitig beeinflussen. Stereo-Tiefenkameras gibt es in allen Preisklassen, abhängig von der gewünschten Genauigkeit und Reichweite.

Stereo-Vision

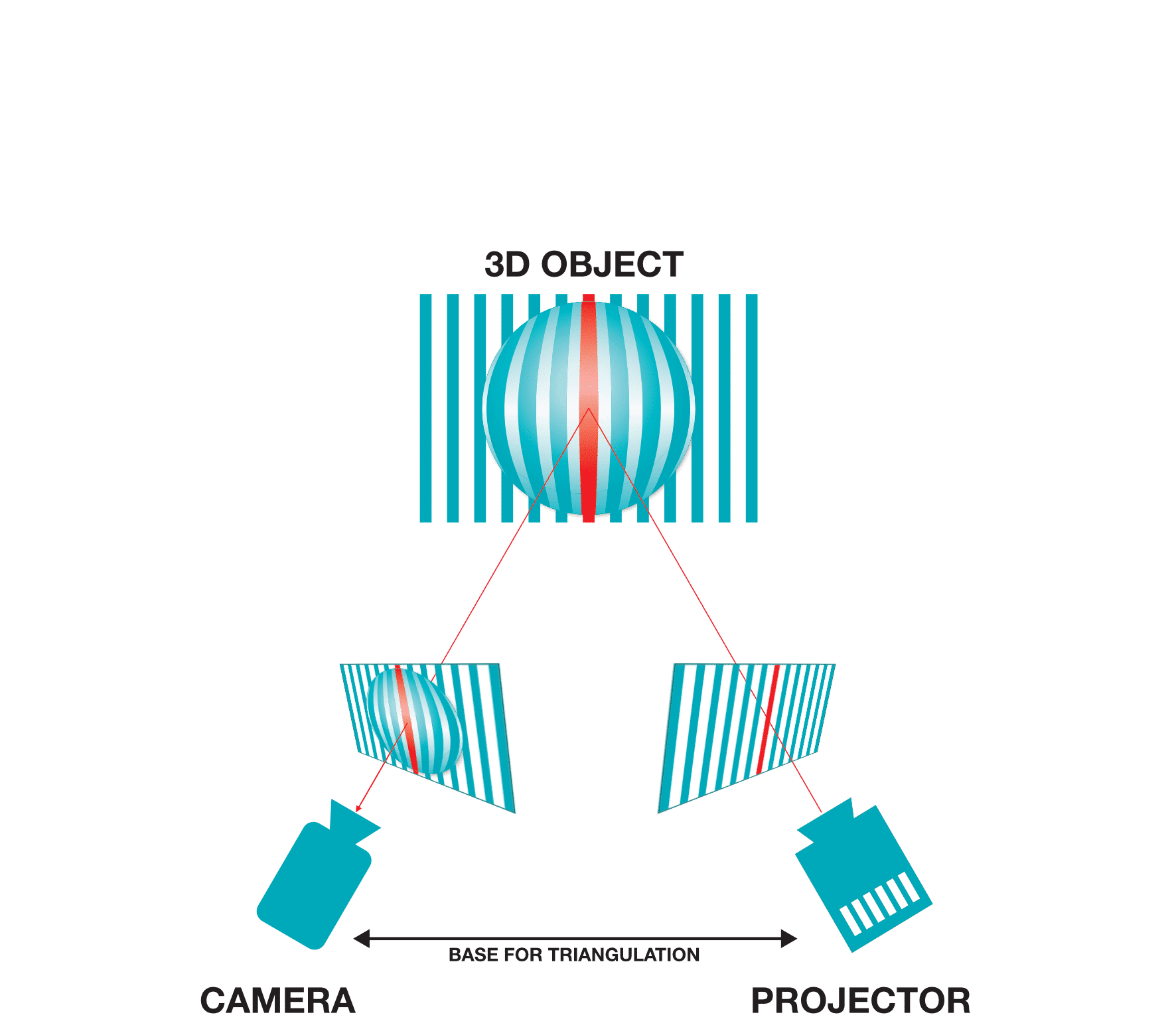

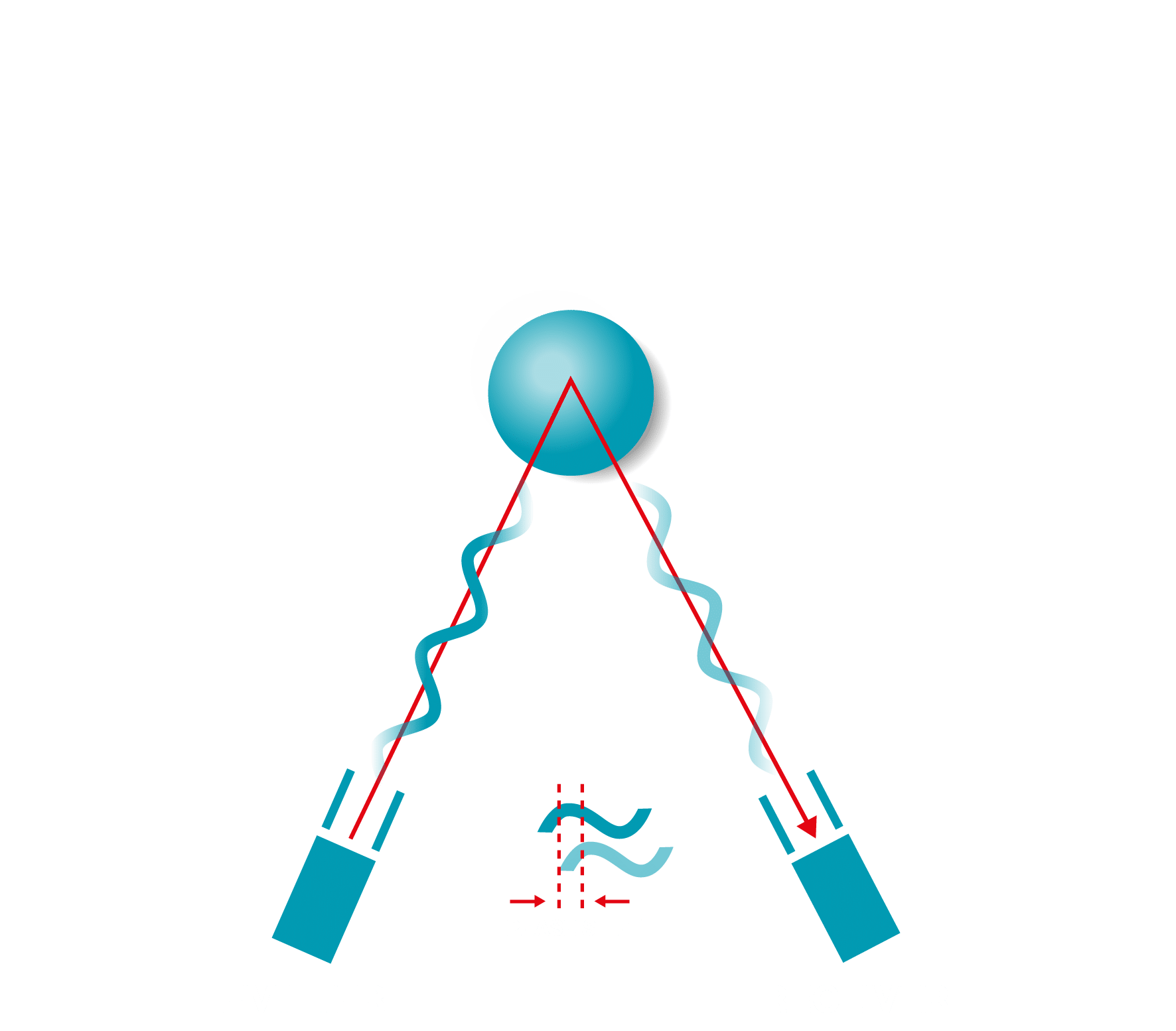

Funktionsprinzip Strukturiertes Licht

Strukturiertes Licht nutzt ein bekanntes Lichtmuster, das mit einem Projektor auf ein Objekt oder eine Szene projiziert und von mindestens einer Kamera aufgezeichnet wird. In der Regel werden bei der Projektion punkt-, streifen- oder farbcodierte Muster verwendet; es sind aber auch zeitcodierte Muster möglich. Kameras, die in einem bekannten Winkel zum Projektor aufgestellt sind, nehmen das verzerrte Muster auf, wobei sich die Kamera und der Projektor normalerweise in einem Gerät befinden. Durch die Berechnung der Differenz zwischen dem projizierten Muster und dem von der Kamera beobachteten verzerrten Muster kann die Tiefe der Szene ermittelt und als Tiefenkarte dargestellt werden. Diese Methode ist für transparente Objekte, stark reflektierende Oberflächen oder große Entfernungen nicht besonders geeignet. Außerdem wird die Rekonstruktion der Tiefe beeinträchtigt, wenn mehrere Kameras eine Szene mit sich überschneidenden Sichtfeldern erfassen oder wenn externe Lichtquellen mit gleicher Wellenlänge hinsichtlich des projizierten Musters Interferenzen verursachen. Vorteile von strukturiertem Licht sind eine hohe Genauigkeit bei kurzen Entfernungen und attraktivere Kosten im Vergleich zu anderen Technologien.

STRUKTURIERTES LICHT

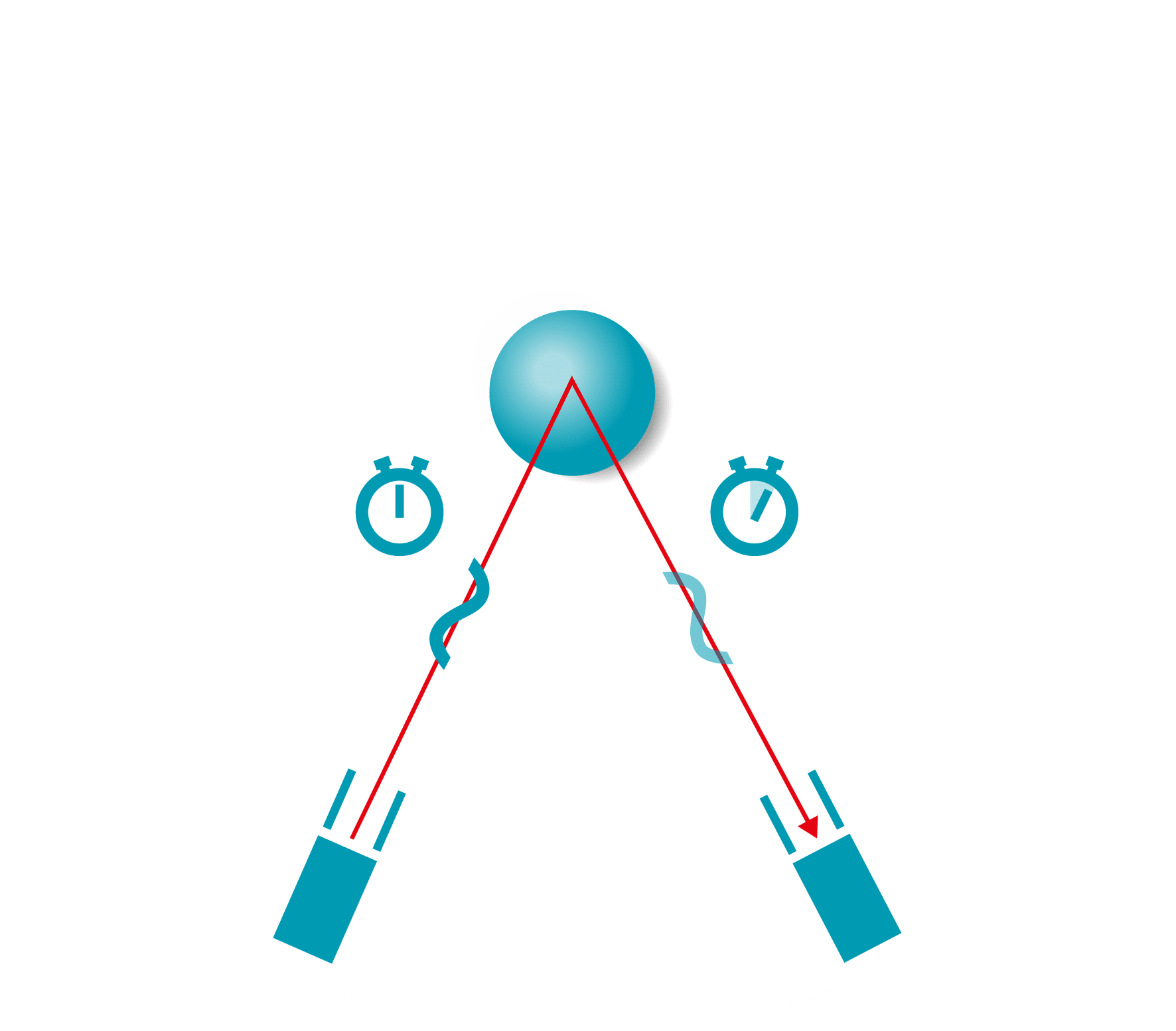

Funktionsprinzip Time of Flight

In der Computer Vision beruht Time of Flight (ToF) auf dem Prinzip der Messung der Zeit, die das Licht benötigt, um eine bestimmte Entfernung zurückzulegen. Über Lichtgeschwindigkeit kann man die Entfernung zwischen Sender und Empfänger (die sich normalerweise in einem Gerät befinden) berechnen, da die Laufzeit direkt proportional zur Entfernung ist. Das Licht wird in der Regel von einer LED oder einem Laser mit Infrarot-Spektrum erzeugt. Es sind verschiedene Ausführungen möglich. Üblicherweise unterscheidet man zwischen „Flash“-basierten Time-of-Flight-Kameras und scannenden LiDAR Systemen (Light Detection and Ranging) sowie direkten und indirekten ToF-Systemen.

Wie beim strukturierten Licht sind auch Kameras, die nach dem ToF-Prinzip arbeiten, anfällig für Störungen durch andere Kameras oder externe Lichtquellen, die Licht mit gleicher Wellenlänge aussenden. Bei Multi-Kamerakonfigurationen lässt sich dieser Nachteil durch die Synchronisation der Kameras vermeiden. Vorteile sind insgesamt die hohe Genauigkeit, die Unabhängigkeit von externen Lichtquellen und die Möglichkeit, Tiefeninformationen von Oberflächen mit wenig oder gar keiner Textur zu erfassen.

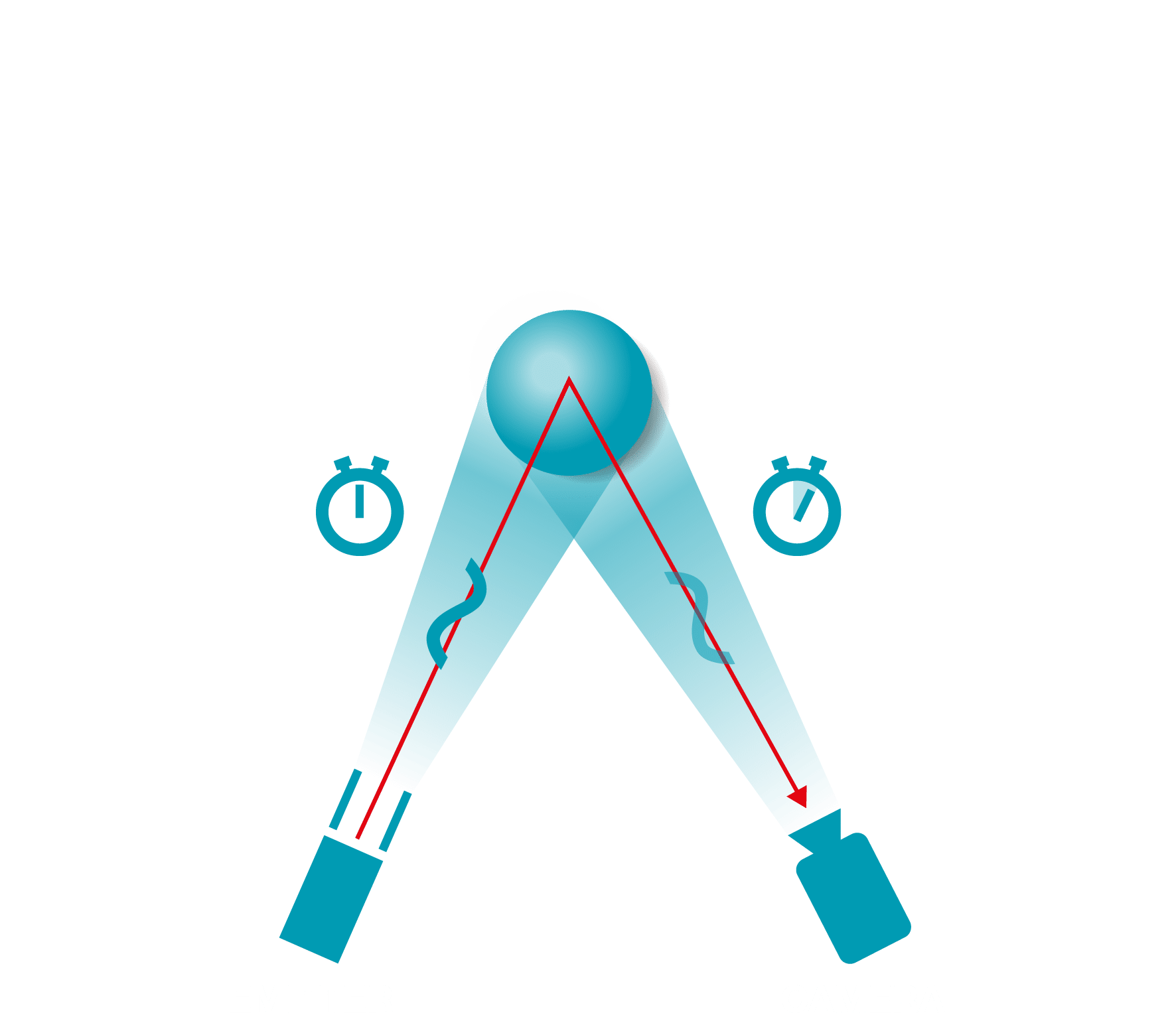

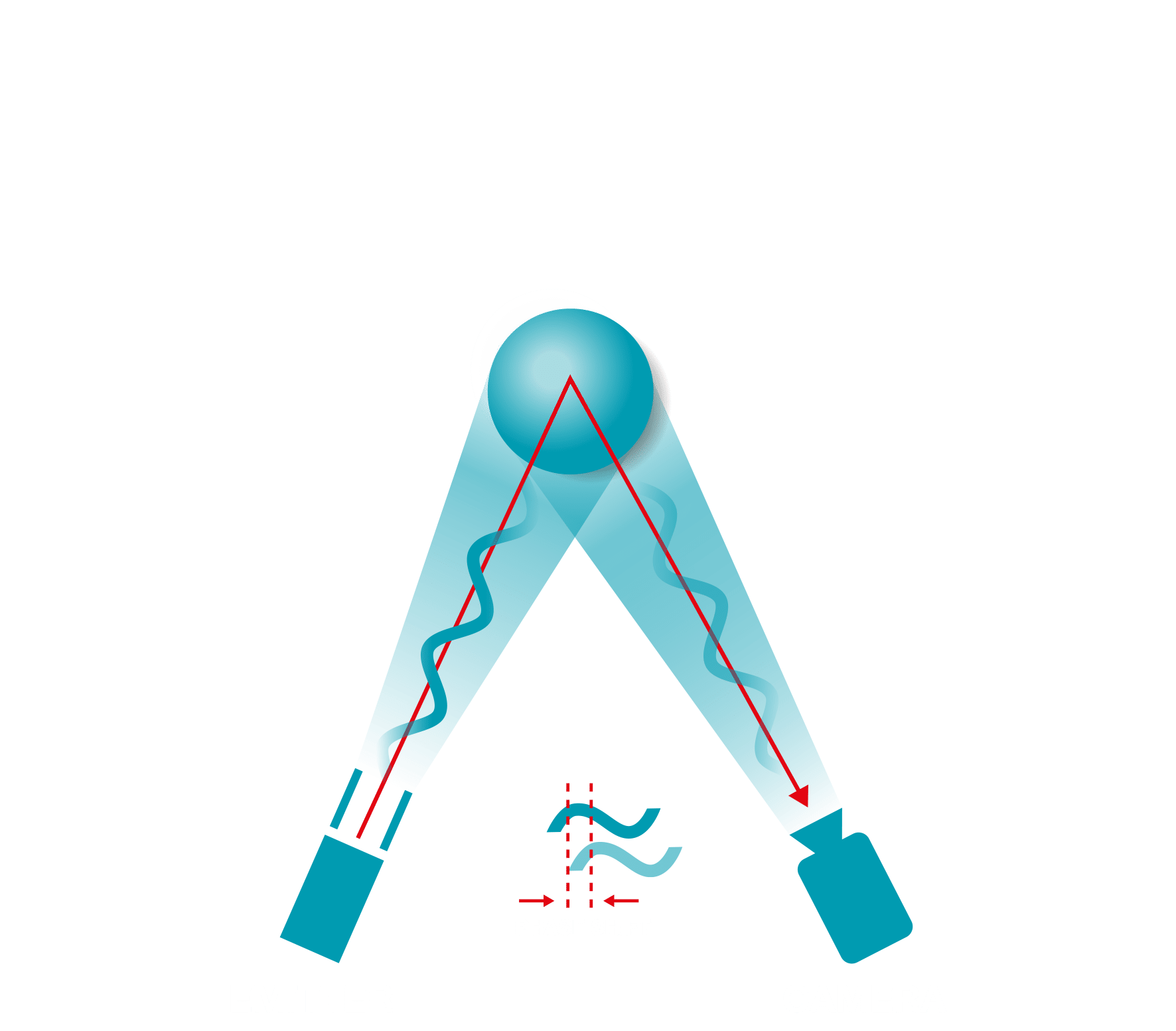

Direkte und indirekte Lichtlaufzeit (ToF)

DIREKTES TOF SCANNEN

INDIREKTES TOF SCANNEN

Beim direkten ToF (dToF) wird ein einzelner Impuls ausgesendet und die Entfernung anhand der Zeitdifferenz zwischen dem Aussenden des Impulses und seiner Reflexion berechnet. Beim indirekten ToF (iToF) wird ein kontinuierlicher modulierter/kodierter Lichtstrahl genutzt. Die Entfernung wird dann anhand der Phasendifferenz zwischen dem ausgesandten und dem empfangenen reflektierten Licht berechnet. dToF wird meist in scannenden LiDARs eingesetzt (siehe Bild zum ToF-Prinzip). Während iToF das übliche Prinzip für blitzbasierte Kameras ist (siehe Bild iToF-Kamera).

iToF bietet den Vorteil einer höheren Genauigkeit ohne extrem hohe Abtastraten des Laser-/ Lichtpulses zu benötigen. Somit können höhere Auflösungen und Sichtfelder mit hohen Bildraten zu angemessenen Kosten realisiert werden.

Flash-basierte ToF-Kameras

DIREKTER TIME OF FLIGHT FLASH

INDIREKTES TIME OF FLIGHT FLASH

Typischerweise arbeiten Flash-basierte Time-of-Flight-Kameras mit klassischen Bildsensor-Arrays und moduliertem (indirektem) Licht, wobei eine Szene komplett ausgeleuchtet wird. Sie können eine Szene mit nur einer einzigen Aufnahme abbilden. Das bedeutet, dass der optimale Arbeitsbereich kurze bis mittlere Entfernungen abdeckt, da die maximale Reichweite von der Leistung der Lichtquelle abhängt. Hohe Bildraten und günstige Kosten machen diese Kameras für viele Anwendungen interessant, z. B. bei der Bestimmung von Abmessungen beim Wiegen von Paketen in der Logistik.

LiDAR

Lidar (Light detection and ranging) wird oft synonym mit einer speziellen scannenden ToF-Technologie verwendet. Obwohl der Begriff auf alle ToF Kameratechnologien zutrifft. Normalerweise bestehen diese LiDAR-Systeme aus einer Laserquelle, die Laserpulse aussendet, einem Scanner, der das Licht auf die Szene ablenkt und einem Detektor, der das reflektierte Licht erfasst. Das Scannen der Szene erfolgt üblicherweise durch einen mechanischen Spiegel, der den Laserstrahl, wie bei dToF, über eine Szene lenkt. In letzter Zeit gewinnen iToF-Festkörperlaser immer mehr an Bedeutung, wobei ein MEMS-Spiegel zur Ablenkung des Laserstrahls eingesetzt wird.

Der Scanvorgang wird pro Sekunde mehrere Millionen Mal wiederholt. Er erzeugt eine präzise 3D-Punktewolke der Umgebung. Allgemeine Vorteile sind eine hohe Präzision, Zuverlässigkeit und große Reichweiten (je nach Leistung des Lasers).